août 24, 2025

|13 minutes de lecture

In the milliseconds it takes for a webpage to load, a high-stakes decision is made that can define your brand’s reputation. When your meticulously crafted B2B advertisement appears, will it sit proudly beside a credible industry analysis in a trade journal? Or will it materialize next to a sophisticated deepfake video of a CEO spreading market misinformation, just as a key prospect is doing their due diligence on your company? One click, one bad placement, and a multi-million dollar deal could be put in jeopardy before your sales team even knows what happened. This is the central, unavoidable challenge of modern digital advertising. Artificial Intelligence (AI) has given B2B marketers unmatched power for precision targeting and campaign efficiency. However, this double-edged sword also introduces complex new threats to your brand’s safety. Navigating this landscape requires more than just defensive tools—it demands a proactive and intelligent strategy to protect your most valuable asset: your brand’s integrity. What you’ll learn in this guide

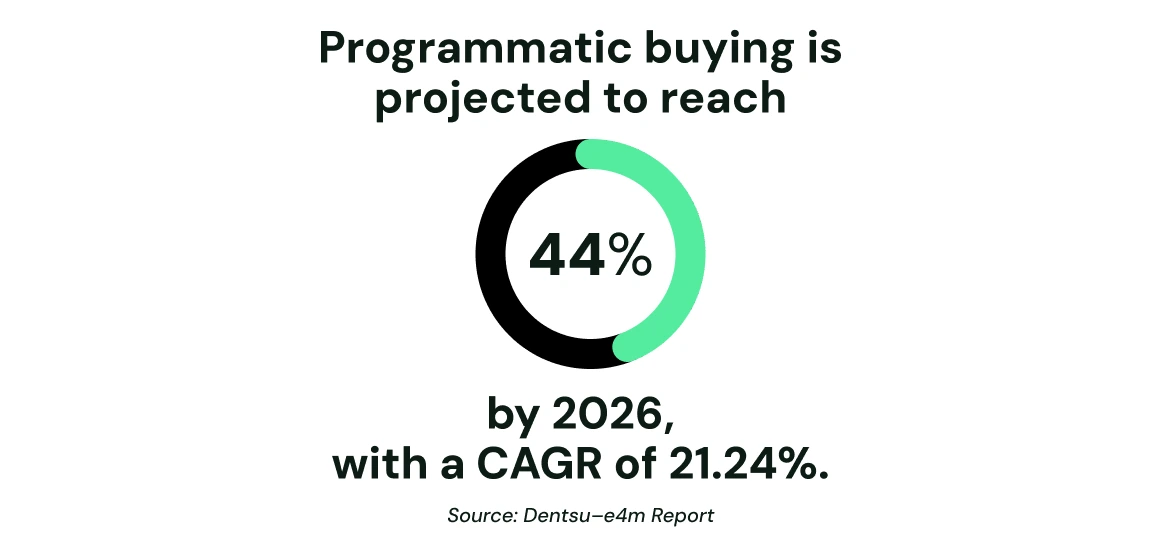

Not long ago, brand safety was a straightforward concept. Marketers relied on whitelists of trusted websites and keyword blocklists to steer clear of universally unsafe categories like violence, adult content, or hate speech. But this approach had its flaws. A brand might block the word “crash” to avoid negative associations, only to miss out on opportunities to appear alongside stories like “crashing the market with innovative technology.” It was a blunt instrument: manageable, but inefficient. Then came programmatic advertising. The automation of ad buying across millions of websites brought immense efficiency—but at a cost. Marketers lost visibility and control, as trillions of ad auctions now happen daily in a « programmatic black box. » Manual oversight became impossible. This shift from direct placements to algorithm-driven delivery created a new, complex brand safety challenge: protecting brand integrity in an unpredictable and opaque digital ecosystem.  According to the Dentsu-e4m report, programmatic buying accounted for 42% of digital ad spend in 2024—a 21% increase over the previous year. This growth is set to continue, with programmatic expected to claim 44% of the market by 2026, growing at a CAGR of 21.24%. With such a significant portion of ad spend now mediated by algorithms, brands are increasingly surrendering control over where their ads appear. In this reality, a reactive approach to brand safety is no longer enough. A strategic, AI-conscious model is essential to maintain brand integrity in a fast-evolving, automated ecosystem.

According to the Dentsu-e4m report, programmatic buying accounted for 42% of digital ad spend in 2024—a 21% increase over the previous year. This growth is set to continue, with programmatic expected to claim 44% of the market by 2026, growing at a CAGR of 21.24%. With such a significant portion of ad spend now mediated by algorithms, brands are increasingly surrendering control over where their ads appear. In this reality, a reactive approach to brand safety is no longer enough. A strategic, AI-conscious model is essential to maintain brand integrity in a fast-evolving, automated ecosystem.

The modern landscape demands a shift from basic brand safety to strategic brand suitability. For B2B, where reputation and trust are paramount to long sales cycles and high-value deals, this is non-negotiable. It’s no longer enough just to avoid inappropriate content; the goal is to find environments that reinforce expertise and credibility proactively. Using advanced AI to analyze context and sentiment, leaders can ensure their brand appears alongside positive industry analysis, not reports of corporate failure. This transforms brand safety from a defensive cost center into a performance driver, maximizing ROI by ensuring marketing investments build trust with high-value accounts.

For global B2B companies, brand safety impacts investor confidence, partner relationships, and client trust. An ad appearing next to false financial news or polarizing content can jeopardize long-term deals and market perception. Modern brand safety demands AI-powered tools that assess tone, emotion, and values alignment, not just content classification. It requires integration across marketing, legal, and compliance teams to enforce governance at every touchpoint. For enterprise marketers, the question is no longer “How do we avoid bad content?” but “How do we align with the right content, at the right time, in the right context?” Dans un paysage médiatique dense et volatil, la sécurité des marques n’est plus optionnelle. C’est un facteur de différenciation et une condition préalable à la confiance.

In B2B, where long sales cycles, high-value deals, and deep levels of trust are paramount, reputational damage from a single ad misplacement can have severe, long-lasting financial consequences. This challenge is amplified by a complex digital landscape that now includes social media, Connected TV (CTV), and Digital Out-of-Home (DOOH), with AI becoming an engine for creating new and subtle threats. For marketing leaders, the risk is magnified by modern challenges like misinformation, the scalable creation of synthetic content via generative AI, and rapidly shifting cultural norms. These threats are especially difficult to manage across fragmented teams, multiple agencies, and fast-moving environments. However, the core problem is often internal: a lack of clear, documented accountability for who owns brand safety risks and defines acceptable tolerance levels. Technology and AI filters alone cannot solve this governance gap. Therefore, the recommended strategy is to shift from a rigid, purely technological approach to a dynamic model that blends advanced tools with expert human judgment to navigate nuance and context.

The B2B world is built on expertise and trust. AI-generated content, especially deepfakes, directly attacks this foundation. Imaginez une vidéo deepfake d’un analyste respecté du secteur faisant des affirmations négatives fausses sur votre marché, avec votre annonce pour une solution associée apparaissant juste à côté. Cette association accidentelle est instantanément dommageable et peut être capturée d’écran et partagée par des concurrents. Cette menace va au-delà de la vidéo et comprend des blogs « d’experts » générés par l’IA qui promeuvent des données défectueuses ou de faux rapports financiers conçus pour manipuler les perceptions du marché. La menace est telle que les Nations Unies ont appelé à des mesures globales plus strictes pour contrer le contenu deepfake avant qu’il n’érode la confiance publique et d’entreprise (Reuters).

Les algorithmes d’IA sont puissants, mais ils manquent souvent d’une véritable compréhension contextuelle humaine. Ils associent des mots-clés, pas l’intention. Cela conduit à des placements choquants qui peuvent nuire à votre réputation. Imaginez une publicité pour votre logiciel de sécurité cloud apparaissant à côté d’un grand article de presse détaillant une violation de données d’entreprise catastrophique. Alors que les mots-clés correspondent, le contexte fait paraître votre marque déphasée, incompétente, voire prédatrice, sapant la crédibilité de votre solution à un moment critique.

Pour un public professionnel sophistiqué, la transparence est non négociable. Les acheteurs B2B sont des chercheurs ; ils repèrent une fausse information à des kilomètres. Si une entreprise technologique B2B utilisait un témoignage vidéo entièrement généré par l’IA d’un « client » louant sa plateforme, sa découverte par des acheteurs avertis serait catastrophique. Les accusations de tromperie briseraient l’authenticité de la marque. Ces dommages ne sont pas uniquement externes ; ils affectent le moral des employés et la capacité de recruter les meilleurs talents qui veulent travailler pour une entreprise en laquelle ils peuvent avoir confiance. Dans le B2B, se remettre d’un déficit de confiance est extrêmement difficile.

Sites faits pour la publicité (MFA) A huge and insidious drain on marketing budgets comes from low-quality MFA sites. These are websites algorithmically generated and filled with stolen or spun junk content, designed for one purpose: to collect ad revenue through programmatic channels. Ils utilisent souvent des pratiques trompeuses comme le stacking d’annonces (superposition de plusieurs annonces) et le remplissage de pixels (crammer des annonces dans un seul pixel) pour tromper les annonceurs. Une étude marquante de l’ANA (Association of National Advertisers) a montré que les sites MFA représentent 15 % des dépenses publicitaires programmatiques, siphonnant des milliards des éditeurs légitimes et des campagnes à fort impact vers un « trou noir numérique ».

Les plateformes modernes de sécurité des marques offrent désormais un système de défense à plusieurs couches qui opère à la vitesse de la publicité programmatique, en évaluant les placements publicitaires en temps réel.

Les plateformes modernes de sécurité des marques offrent désormais un système de défense à plusieurs couches qui opère à la vitesse de la publicité programmatique, en évaluant les placements publicitaires en temps réel.

Malgré sa puissance, traiter l’IA comme une solution « installer et oublier » est une recette pour l’échec. La technologie présente des angles morts et des limites inhérentes qui exigent une gestion stratégique.

Compte tenu des limites de l’IA, la supervision humaine n’est pas une fonction du passé — c’est un composant stratégique essentiel. Les marques les plus intelligentes créent un centre d’excellence en sécurité des marques « Center of Excellence » où des experts humains guident la technologie. Cette approche « humain dans la boucle » est cruciale pour le succès. Cette équipe comprend généralement un spécialiste Ad Ops, un analyste de données, un stratège de marque et un expert en gouvernance et conformité. Ces stratégistes humains apportent le jugement contextuel, le raisonnement éthique et l’expertise sectorielle qui manquent à l’IA. Leur mission n’est pas de passer en revue chaque placement, mais de gérer le système. Un solide processus de révision humaine comprend :

La protection maximale des marques ne se limite plus à éviter le contenu problématique : il s’agit proactivement de rechercher l’environnement idéal. C’est l’évolution cruciale de la sécurité des marques vers l’adéquation de la marque. Où la sécurité des marques fixe le plancher (le standard minimal à éviter), l’adéquation de la marque conçoit toute la demeure (définissant le ton, le contexte et l’environnement idéaux pour votre marque). Cette approche personnalisée aligne les placements publicitaires sur vos valeurs et messages spécifiques. Pour une entreprise de cybersécurité, un article neutre sur la protection des données peut être « sûr », mais une analyse approfondie des menaces émergentes pour la sécurité des entreprises est « adaptée » — et bien plus utile pour atteindre l’état d’esprit du client idéal (Seekr). Développer un cadre d’adéquation est un exercice stratégique qui comprend trois étapes clés :

[X18695Xh2 id= »next »>Quelles sont les prochaines étapes pour la sécurité des marques dans la publicité ?

Le paysage évolue en permanence, porté par trois forces clés :

L’intelligence artificielle offre des opportunités immenses pour les marketeurs B2B, permettant un niveau de précision et d’échelle autrefois inimaginable. Mais elle engendre aussi des risques profonds pour la valeur qui compte le plus dans les affaires : la confiance et la réputation. Le succès ne réside pas dans le choix entre innovation et responsabilité, mais dans l’art de les équilibrer. L’avenir de la publicité appartient à ceux qui savent diriger la technologie, et pas seulement la suivre. En combinant la puissance d’outils IA sophistiqués avec la sagesse de la supervision humaine — et en élevant votre objectif du simple ‘safety’ à l’adéquation holistique de la marque — vous pouvez naviguer cette nouvelle frontière avec assurance. Cette approche protégera non seulement la réputation durement gagnée de votre marque, mais elle renforcera également une connexion plus résiliente, authentique et rentable avec vos clients.

Please enter your email address so we can send you a one-time pass code and verify if you are an existing subscriber.